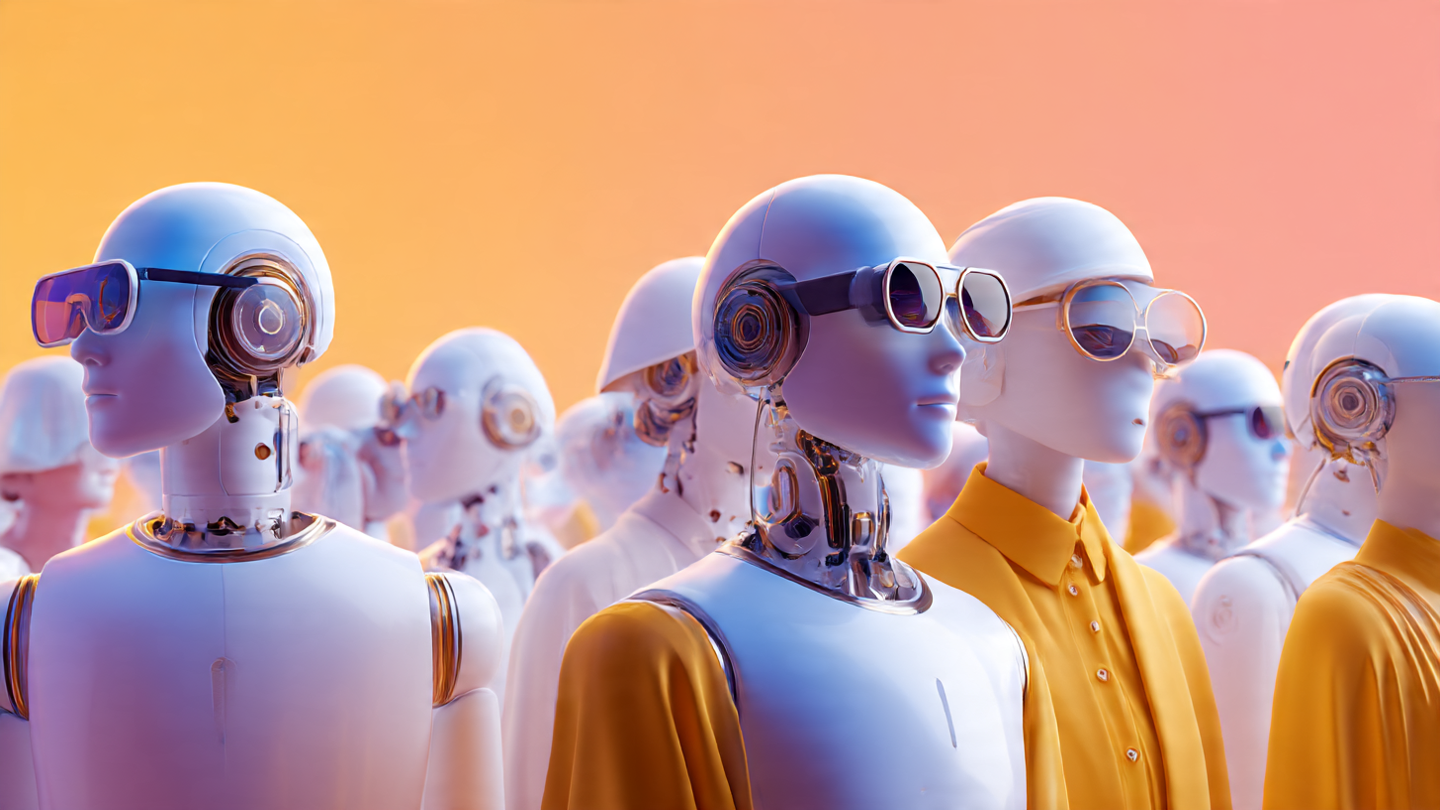

Los agentes de inteligencia artificial autónomos están dejando de ser un experimento de laboratorio para convertirse en parte activa de la vida diaria. Estas plataformas, capaces de tomar decisiones, ejecutar órdenes y aprender de sus errores sin intervención humana directa, están redefiniendo la relación entre las personas y la tecnología.

Inspirados en modelos como AutoGPT y BabyAGI, los agentes IA pueden planear viajes, escribir código, gestionar presupuestos o incluso coordinar eventos completos. Su funcionamiento se basa en un principio simple pero poderoso: una IA que no sólo responde preguntas, sino que actúa para cumplir objetivos definidos por el usuario.

El crecimiento de esta tecnología ha sido vertiginoso. En redes sociales, el hashtag #AIAgents acumula decenas de millones de menciones tras demostraciones virales, como el caso de un agente que planeó una boda entera en menos de cinco minutos o el de otro que reorganizó la agenda de una pequeña empresa para evitar su quiebra. Este tipo de casos muestran cómo los usuarios comunes comienzan a integrar la IA como asistente operativo real, no sólo como herramienta de consulta.

Empresas globales han incorporado esta tendencia en sus procesos. Plataformas de productividad, finanzas y recursos humanos integran ya “agentes inteligentes” capaces de analizar datos, generar reportes automáticos y tomar decisiones rutinarias, liberando a los trabajadores de tareas repetitivas. Se estima que, en sectores administrativos, los agentes IA podrían reducir hasta en un 40% el tiempo destinado a labores operativas.

En paralelo, el mercado tecnológico se prepara para un cambio de escala. Consultoras internacionales proyectan que el valor global de los agentes autónomos superará los 100 mil millones de dólares para 2030, impulsado por la adopción en empresas, educación, salud y entretenimiento. Este crecimiento refleja no sólo la confianza en la tecnología, sino la necesidad de optimizar la productividad en un mundo cada vez más digitalizado.

Pero el avance trae consigo dilemas éticos. Expertos en inteligencia artificial advierten que los agentes autónomos representan un nuevo tipo de riesgo: al delegar decisiones críticas —como aprobar transacciones, diagnosticar enfermedades o gestionar información sensible— se abren preguntas sobre responsabilidad, seguridad y transparencia. ¿Quién responde cuando un algoritmo actúa mal? ¿El usuario, el programador o la máquina?

Gobiernos y organismos internacionales han comenzado a discutir marcos regulatorios para establecer límites claros al uso de IA autónoma. En la Unión Europea, se trabaja en leyes que obliguen a etiquetar los contenidos y decisiones generadas por IA, mientras que en Estados Unidos se debate la creación de auditorías externas para garantizar que las acciones de los agentes sean verificables.

Para los usuarios comunes, la llegada de los agentes IA marca una nueva etapa. Estas herramientas ya pueden gestionar agendas, redactar correos, analizar bases de datos o negociar precios en línea. Sin embargo, los especialistas recomiendan usarlas con precaución: revisar los permisos, entender qué datos comparten y supervisar sus acciones antes de darles autonomía total.

El futuro de los agentes IA autónomos apenas comienza. Lo que antes parecía ciencia ficción —máquinas que piensan, deciden y actúan solas— ahora ocurre en tiempo real, en teléfonos, computadoras y entornos empresariales. La pregunta ya no es si cambiarán el mundo, sino cómo los humanos aprenderán a convivir con ellos.